guia posicionamiento web (1).pdf

Vista previa de texto

Haz un uso efectivo del robots.txt

rastreado. Matt Cutts, un ingeniero de Google, nos guía sobre las

características de cada método de bloqueo en este video tan útil.

El archivo “robots.txt” les dice a los motores de búsqueda a

qué partes de tu sitio (1) pueden acceder y

consecuentemente rastrear. Este archivo se debe llamar

“robots.txt”, y tiene que estar en el directorio raíz de tu sitio. (2)

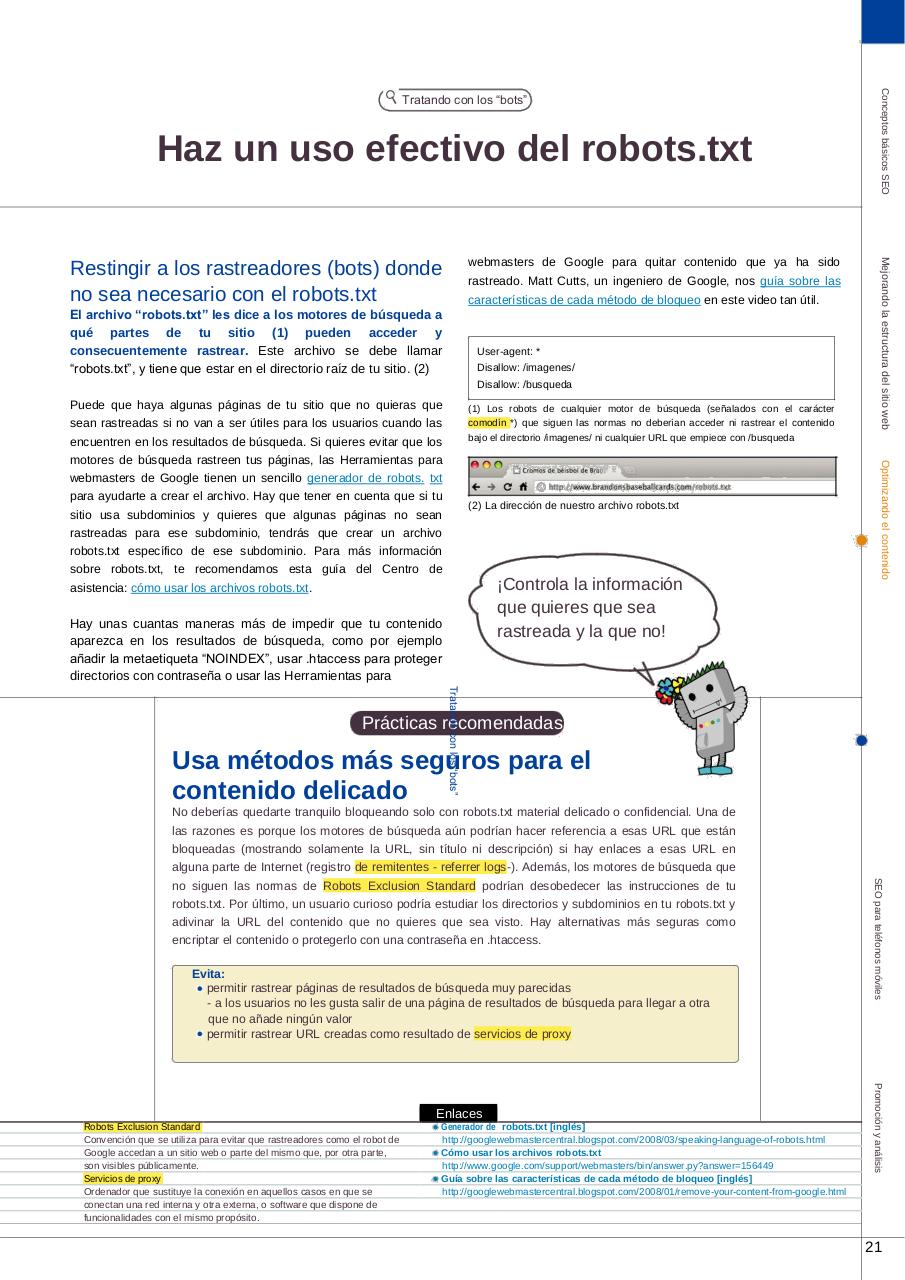

User-agent: *

Disallow: /imagenes/

Disallow: /busqueda

(1) Los robots de cualquier motor de búsqueda (señalados con el carácter

comodín *) que siguen las normas no deberían acceder ni rastrear el contenido

bajo el directorio /imagenes/ ni cualquier URL que empiece con /busqueda

(2) La dirección de nuestro archivo robots.txt

¡Controla la información

que quieres que sea

rastreada y la que no!

Hay unas cuantas maneras más de impedir que tu contenido

aparezca en los resultados de búsqueda, como por ejemplo

añadir la metaetiqueta “NOINDEX”, usar .htaccess para proteger

directorios con contraseña o usar las Herramientas para

Optimizando el contenido

Puede que haya algunas páginas de tu sitio que no quieras que

sean rastreadas si no van a ser útiles para los usuarios cuando las

encuentren en los resultados de búsqueda. Si quieres evitar que los

motores de búsqueda rastreen tus páginas, las Herramientas para

webmasters de Google tienen un sencillo generador de robots. txt

para ayudarte a crear el archivo. Hay que tener en cuenta que si tu

sitio usa subdominios y quieres que algunas páginas no sean

rastreadas para ese subdominio, tendrás que crear un archivo

robots.txt específico de ese subdominio. Para más información

sobre robots.txt, te recomendamos esta guía del Centro de

asistencia: cómo usar los archivos robots.txt.

Mejorando la estructura del sitio web

webmasters de Google para quitar contenido que ya ha sido

Restingir a los rastreadores (bots) donde

no sea necesario con el robots.txt

Conceptos básicos SEO

Tratando con los “bots”

Tratando con los “bots”

Prácticas recomendadas

Usa métodos más seguros para el

contenido delicado

No deberías quedarte tranquilo bloqueando solo con robots.txt material delicado o confidencial. Una de

las razones es porque los motores de búsqueda aún podrían hacer referencia a esas URL que están

robots.txt. Por último, un usuario curioso podría estudiar los directorios y subdominios en tu robots.txt y

adivinar la URL del contenido que no quieres que sea visto. Hay alternativas más seguras como

encriptar el contenido o protegerlo con una contraseña en .htaccess.

Evita:

permitir rastrear páginas de resultados de búsqueda muy parecidas

- a los usuarios no les gusta salir de una página de resultados de búsqueda para llegar a otra

que no añade ningún valor

permitir rastrear URL creadas como resultado de servicios de proxy

Generador de robots.txt [inglés]

http://googlewebmastercentral.blogspot.com/2008/03/speaking-language-of-robots.html

Cómo usar los archivos robots.txt

http://www.google.com/support/webmasters/bin/answer.py?answer=156449

Guía sobre las características de cada método de bloqueo [inglés]

http://googlewebmastercentral.blogspot.com/2008/01/remove-your-content-from-google.html

Promoción y análisis

Enlaces

Robots Exclusion Standard

Convención que se utiliza para evitar que rastreadores como el robot de

Google accedan a un sitio web o parte del mismo que, por otra parte,

son visibles públicamente.

Servicios de proxy

Ordenador que sustituye la conexión en aquellos casos en que se

conectan una red interna y otra externa, o software que dispone de

funcionalidades con el mismo propósito.

SEO para teléfonos móviles

bloqueadas (mostrando solamente la URL, sin título ni descripción) si hay enlaces a esas URL en

alguna parte de Internet (registro de remitentes - referrer logs-). Además, los motores de búsqueda que

no siguen las normas de Robots Exclusion Standard podrían desobedecer las instrucciones de tu

21